Fundadora de la Liga de Justicia Algorítmica, es una mujer especialista en informática y activista digital.

Buolamwini nació en Canadá en 1989, pero creció en el estado de Misisipi en los Estados Unidos. Con base en el ‘Robot Kismet’ de los 90, aprendió como autodidacta el XHTML, el lenguaje Javascript y PHP; combinando esto con el atletismo (salto con garrocha) que practicó de forma profesional. Hizo la carrera de informática en Georgia, basándose en investigación de informática médica, lo que le valió la beca del programa Stamps President’s Scholar del Instituto de Tecnología de Georgia en el año 2012.

También logró ser la finalista más joven en 2009 del premio de Tech inVenture, obtuvo las becas Rhodes, Fulbright, Stamps, Astronaut y la del Instituto Anita Borg; estudió en la Universidad de Oxford tecnología y educación. Entre sus múltiples facetas también están los proyectos para la comunidad y se licenció en 2017 en el Instituto de Tecnología de Massachusetts.

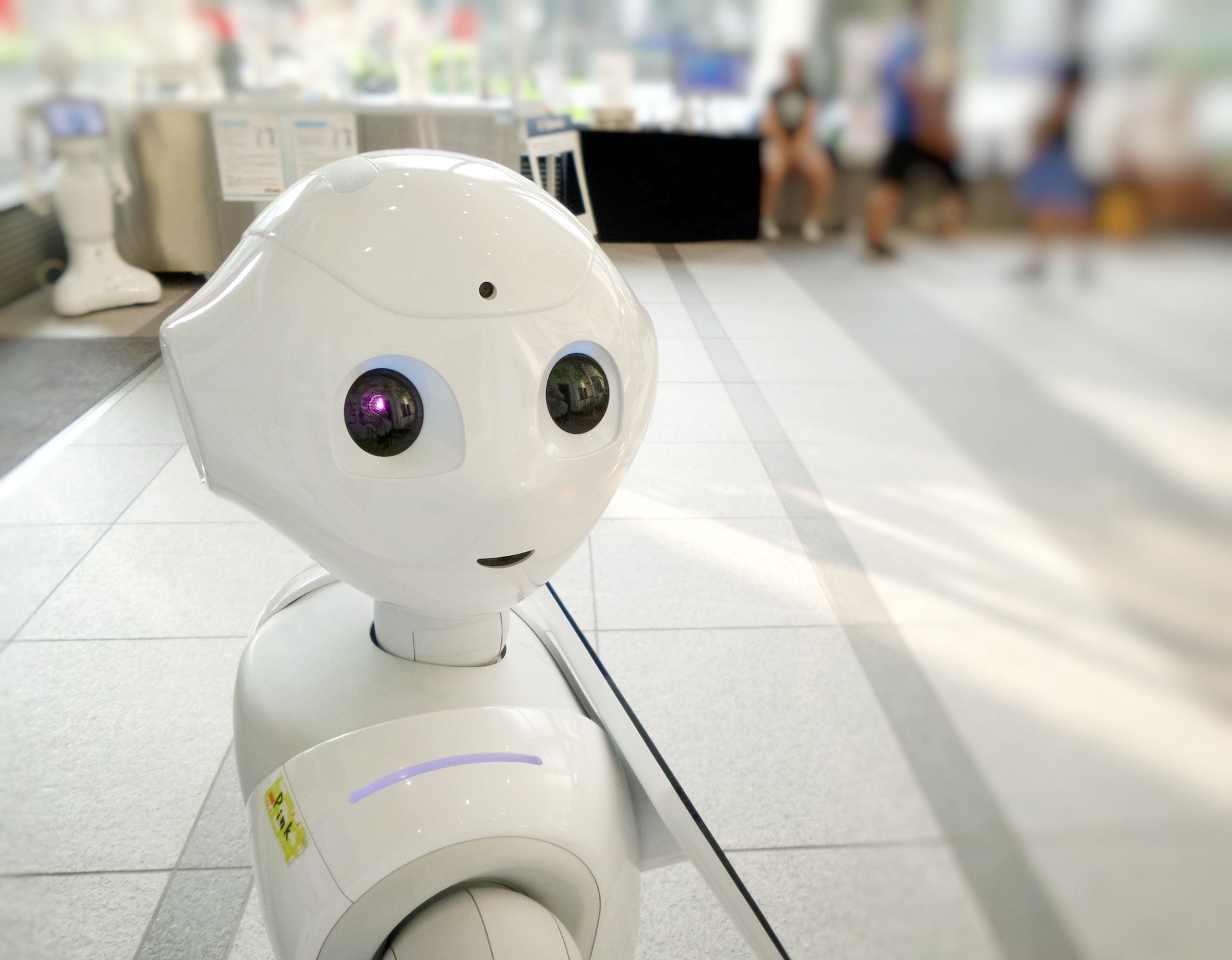

Ella fue seleccionada entre las 100 mujeres más inspiradoras e influyentes por la BBC en 2018, trabaja incansablemente por hacer la diferencia en el sesgo en los algoritmos, que manejan la inteligencia artificial en todo sentido. Todo comenzó cuando quiso hacer un simple juego con un robot que no reconoció su rostro por el color de su piel, por lo que tuvo que usar una máscara blanca, en ese tiempo su choque con la inteligencia artificial la puso de camino a Hong Kong a una competencia de emprendedores, y allá supo que el sesgo existe en todas partes del mundo y depende de las personas que alimentan los algoritmos.

Twitter: @jovialjoy

Estas diferencias tan complejas amplifican las injusticias y la discriminación por motivos raciales, religiosos, políticos y sociales. Las mismas fallas se muestran en sistemas policiales de forma histórica, aplicando el racismo, suponiendo una actitud de una persona por ser de color. Igualmente ocurre con los sistemas predictivos que deberían detectar posibles eventos, y así se comenten abusos que incluyen a personas vulnerables, sistema de selección de personal estandarizados, arbitrarios, que no van a la esencia de la persona sino a una tabla global que perjudica enormemente a la mayoría. Lo vemos también en los sistemas crediticios y hasta en los procesos migratorios, donde la entrevista está diseñada para decirte que NO.

El hombre en su carrera por la automatización avanza en la inteligencia artificial, queriendo aparentar objetividad, pero se ubica en una brecha entre hombres y mujeres, sumado a la exclusión de grupos minoritarios. Es porque se diseña y desarrolla desde una óptica “particular”, la de hombres blancos de élite, ya que son ellos los que ocupan las posiciones más altas y decisivas dentro del campo de desarrollos tecnológicos.

Entonces el trabajo que le espera a Joy, es seguir defendiendo la manera en que se diseñan los programas de inteligencia artificial, porque las desigualdades sociales estructurales continúan a pasos agigantados, es necesario nivelar hacia dónde va la humanidad en su relación persona a persona y persona inteligencia artificial.